Je réaliserai votre script de web scraping en python

Développeur Python

À propos de ce service

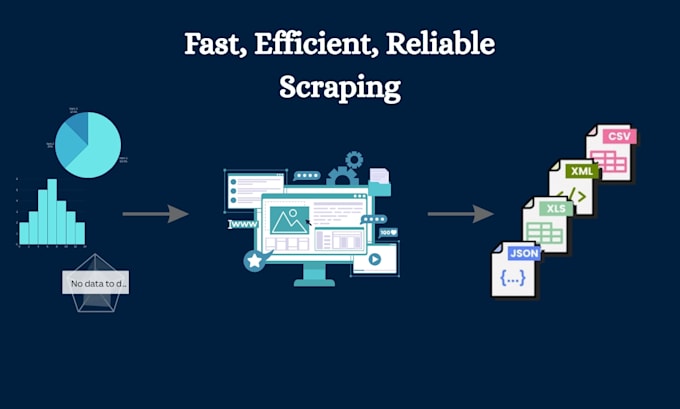

Vous avez besoin d’extraire des données rapidement ? Vous recherchez des données fiables et faciles d’accès ? Vous êtes sur la bonne voie. Je m’occupe de data mining, d’extraction de données, de web scraping et de web crawling en utilisant Python : Scrapy, Selenium, Playwright, Requests, BeautifulSoup. Avec une livraison rapide et une description détaillée du projet, je scraperai toutes les données dont vous avez besoin.

Procédure du projet

1. Fournissez des détails sur les données requises, en précisant les sites cibles, les types de données et le format de livraison préféré.

2. Recherche approfondie des sites et confirmation de la faisabilité du scraping. Les propositions sont émises uniquement après vérification de la viabilité technique du scraping.

3. Une fois les détails du projet et les attentes reçus, les données sont livrées précisément dans le format convenu.

Format disponible pour la livraison :

. CSV

. Excel

. JSON

. XML

. Google Spreadsheets

Satisfaction à 100 % garantie. Contactez-moi pour discuter de votre projet !

Technologie:

JavaScript

•

Python

•

Beautiful Soup

•

Playwright

•

Pandas

Technique:

Automatisé(e)

Mon portfolio

FAQ

Traduction automatique

Pouvez-vous gérer des sites riches en JavaScript ou dynamiques ?

Oui, j’utilise des outils comme Selenium ou Playwright pour rendre le contenu JS entièrement, garantissant une capture complète des données même sur des pages interactives.

Quels formats de données fournissez-vous ?

Les formats standard incluent CSV, Excel, JSON et XML. Je peux également intégrer avec Google Sheets, APIs ou stockage cloud comme S3 sur demande. Tout dépend du package choisi. Tous les formats sont disponibles pour le package Standard et Premium. Le package Basic comprend uniquement un document CSV à la livraison.

Est-ce légal et conforme aux conditions d’utilisation des sites ?

Je me concentre sur des données accessibles publiquement et respecte robots.txt, limites de taux et GDPR/CCPA. Je vérifierai d’abord vos sites cibles pour confirmer la légalité du scraping.

Pouvez-vous gérer du scraping à grande échelle ou planifié ?

Absolument — pour des besoins réguliers comme des mises à jour quotidiennes ou hebdomadaires, je configure des scripts automatisés avec surveillance et alertes.

Quelle est votre procédure pour les projets personnalisés ?

Nous discutons des exigences via messages, je crée un scraper test, je livre un échantillon de données, puis je passe à la livraison complète avec révisions incluses.

Comment garantissez-vous l’exactitude et la qualité des données ?

Chaque scraping inclut des vérifications pour les doublons, champs manquants et formatage. Je fournis d’abord un échantillon pour votre approbation.