Je vais construire un scraper web en Python avec selenium ou beautifulsoup

À propos de ce service

Traduction automatique

Plus de 6 ans d'expérience en Python. Plus de 10 pipelines de scraping livrés pour des clients d'entreprise.

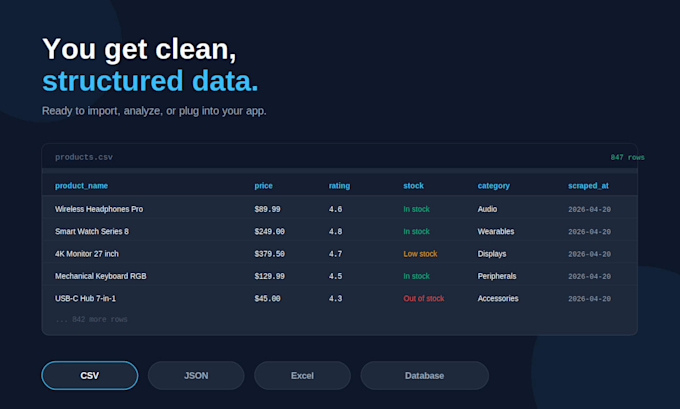

Je vais extraire les données dont vous avez besoin depuis des sites e-commerce, des annuaires, des réseaux sociaux, des annonces immobilières, peu importe, et je vous les livrerai propres et structurées.

Outils que j'utilise :

- BeautifulSoup (rapide, pour sites statiques)

- Selenium / Playwright (pour sites riches en JS)

- httpx / aiohttp (pour un scraping asynchrone haute performance)

- Proxies rotatifs + gestion des user-agents si nécessaire

Vous obtenez :

- Un script Python propre que vous pouvez exécuter vous-même

- Une sortie structurée (CSV, JSON, Excel ou base de données)

- Une documentation pour l'utiliser et le modifier

- Un scraping éthique (respect des robots.txt lorsque pertinent)

Veuillez m'envoyer un message avec l'URL cible avant de commander afin que je puisse vérifier la faisabilité (certains sites sont fortement protégés).

Découvrez Louis J.

Full Stack Developer

- DeFrance

- Membre depuisavr. 2026

Langues

Français, Anglais

Traduction automatique

FAQ

Traduction automatique

Qu'est-ce que je reçois à la fin ?

Vous recevrez un script Python propre que vous pourrez exécuter vous-même sur votre ordinateur ou serveur, ainsi que les données extraites dans le format de votre choix (CSV, JSON, Excel ou directement dans une base). J'inclus une documentation claire pour que vous puissiez l'utiliser, le modifier ou le programmer sans mon aide.

Que se passe-t-il si le site change et que le scraper ne fonctionne plus ?

Les sites évoluent avec le temps, ce qui peut casser un scraper. Les petites corrections dans les 14 jours suivant la livraison sont gratuites. Pour les refontes majeures ou la maintenance à long terme, je propose des forfaits mensuels abordables, contactez-moi pour en discuter.

Que faire si j’ai besoin de plus de 100 pages ?

Pas de problème, mes packages incluent jusqu'à 100 pages, et vous pouvez ajouter l'option "Pages supplémentaires extraites" pour scraper autant que vous le souhaitez. Les projets à grande échelle (plus de 50 000 pages) sont également possibles, contactez-moi pour un devis personnalisé.

Gérez-vous les sites protégés par login ou dynamiques avec JavaScript ?

Oui. J'utilise Selenium et Playwright pour les sites riches en JavaScript (scroll infini, contenu dynamique, données chargées via AJAX). Pour les sites protégés par login, je peux utiliser vos identifiants si le scraping concerne votre propre compte ou un usage autorisé, jamais pour contourner les contrôles d'accès de sites que vous ne possédez pas.